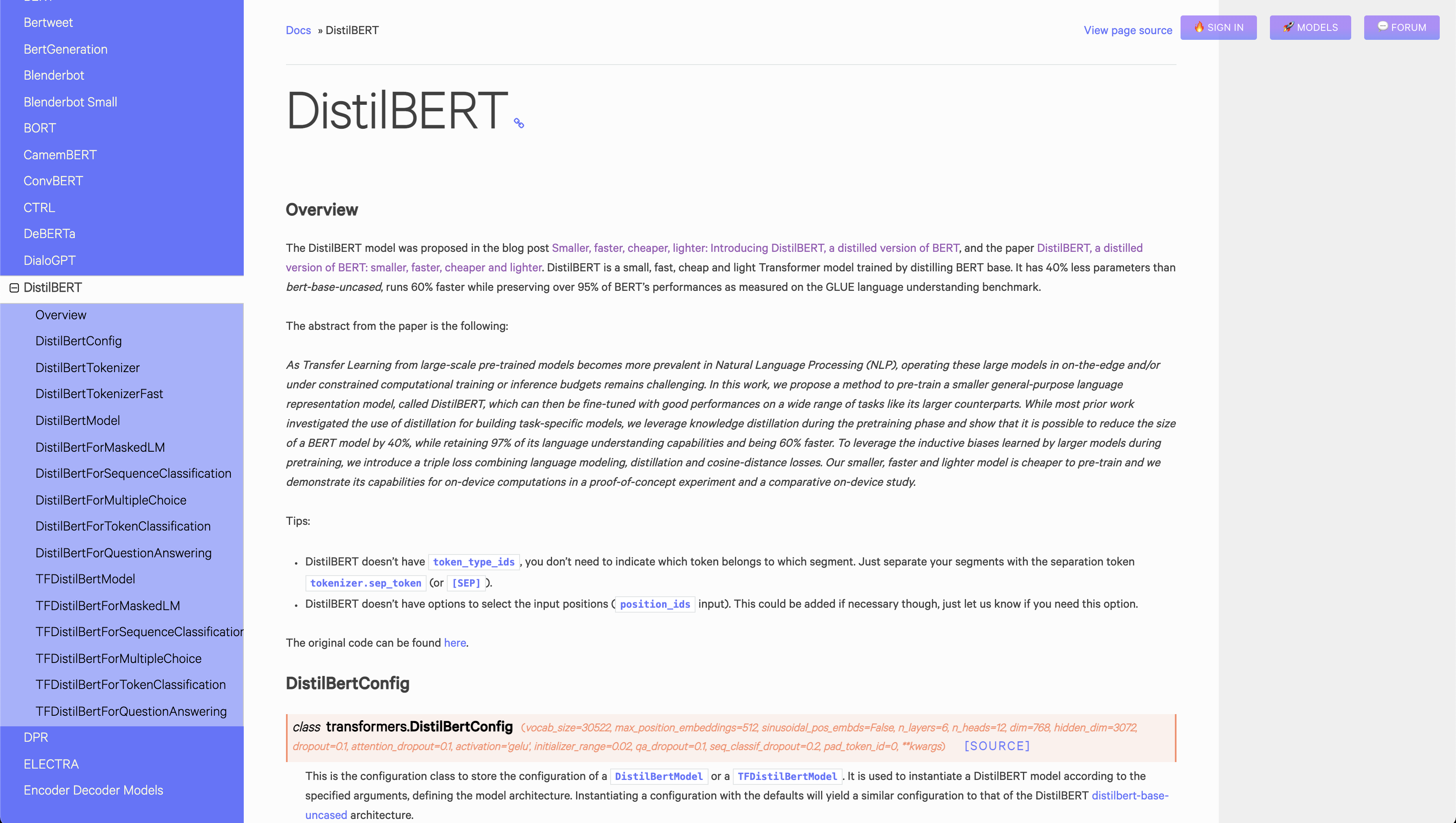

DistilBERT

A a distilled version of BERT: меньше, быстрее, дешевле и легче

О DistilBERT

DistilBERT - это модифицированная версия BERT, модели Transformer, которая была разработана для того, чтобы быть меньше, быстрее, дешевле и легче. Модель способна сохранить более 95% производительности BERT, измеренной на бенчмарке понимания языка GLUE, при условии, что имеет 40% меньше параметров и 60% быстрее. Это было достигнуто за счет использования знаний дистилляции во время фазы предварительной обучения и введения тройной потери, сочетающей моделирование языка, дистилляцию и потерю косинусного расстояния.

Потенциал DistilBERT для вычислений на устройстве демонстрируется в эксперименте принципа действия и сравнительном исследовании на устройстве.

Создан https://huggingface.co/

Скриншоты DistilBERT

Читать на английском

Все о GPT-3

Все о GPT-3