Сайт

Сайт

Категория

GPT-3 Alternative Large Language Models (LLMs)Следующее приложение

Chinese LLaMA & Alpaca LLMsChinchilla by DeepMind

Конкурент GPT-3 от Deepmind

О Chinchilla by DeepMind

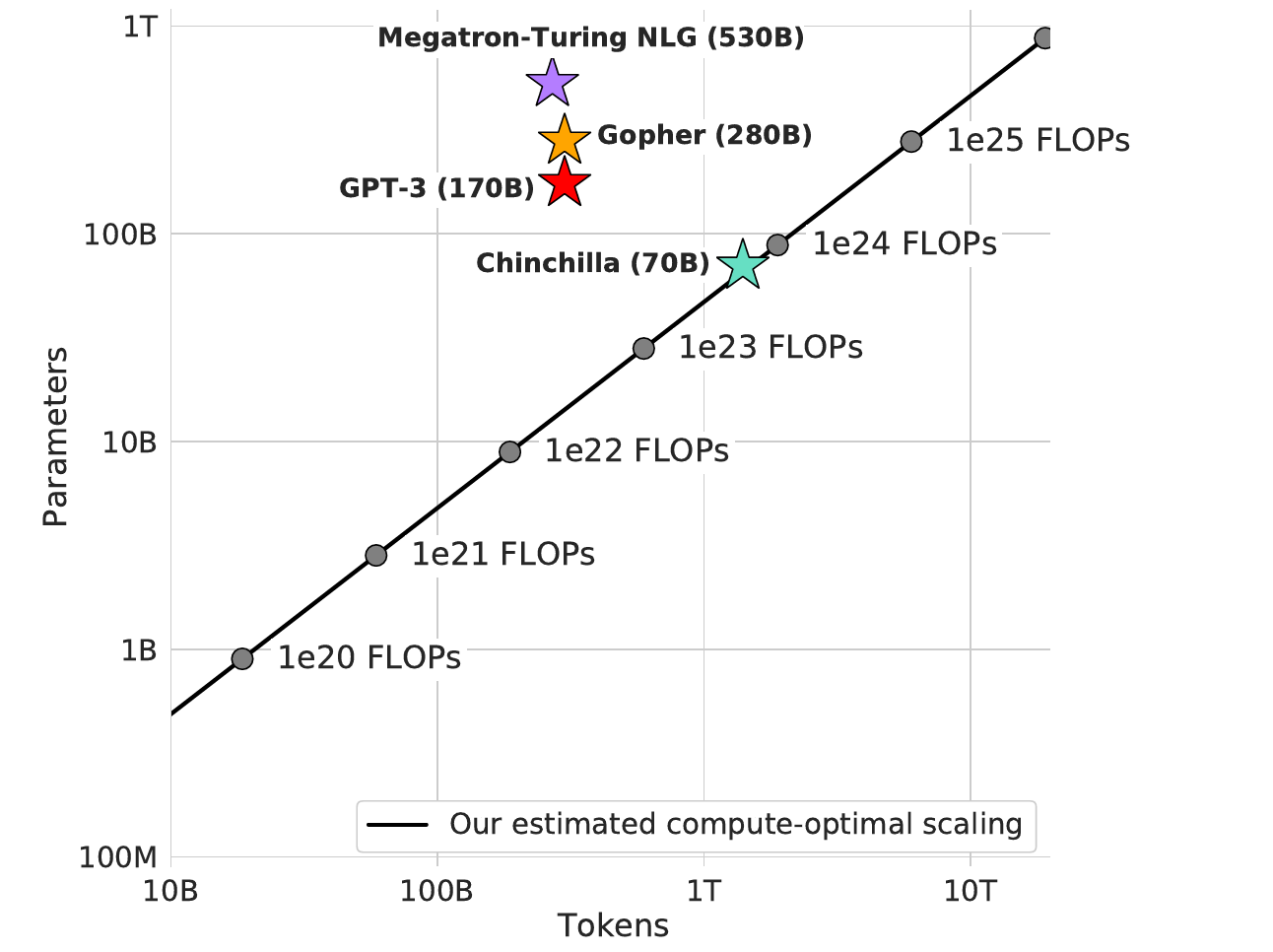

Исследователи DeepMind представили новую модель предсказаний, оптимизированную для вычислений, называемую Chinchilla, которая действует при том же объеме вычислений, что и Gopher, но имеет 70 миллиардов параметров и 4 раза больше данных.

Chinchilla показала превосходство по производительности по сравнению с Gopher (280 млрд), GPT-3 (175 млрд), Jurassic-1 (178 млрд) и Megatron-Turing NLG (530 млрд) в широком диапазоне проверочных тестов. Для настройки и вывода она требует значительно меньше вычислений, что делает использование при настройке намного проще.

Chinchilla показала среднюю точность 67,5%, лучший результат до сих пор, на универсальном бенчмарке MMLU, что составляет 7% улучшение по сравнению с Gopher.

Превалирующая тенденция при обучении крупных языковых моделей заключается в увеличении их размера без увеличения числа токенов, используемых для обучения. Самая большая плотная трансформерная модель MT-NLG 530 Б теперь более чем в 3 раза больше по параметрам, чем 170 миллиардов параметров GPT-3.

Источник: https://analyticsindiamag.com/deepmind-launches-gpt-3-rival-chinchilla/

Скриншоты Chinchilla by DeepMind

Читать на английском

Все о GPT-3

Все о GPT-3